Cómo hacer scripts para web scraping

En el ámbito de la programación, la capacidad de automatizar tareas repetitivas mediante scripts representa un avance clave para optimizar procesos en el manejo de datos en línea. Este artículo se enfoca en explorar cómo desarrollar scripts para web scraping, una técnica esencial en la automatización que permite extraer información de sitios web de manera eficiente y escalable. A través de este contenido, abordaremos los fundamentos necesarios, los pasos prácticos para su implementación y las mejores prácticas para asegurar un enfoque ético y efectivo. Al final, los lectores podrán anticipar no solo una guía detallada, sino también consejos que faciliten la aplicación inmediata en proyectos reales, fomentando una mayor productividad en entornos profesionales.

Fundamentos de la automatización con scripts

La automatización mediante scripts es el pilar fundamental para el web scraping, ya que permite a los desarrolladores ejecutar tareas de extracción de datos sin intervención manual, reduciendo errores y ahorrando tiempo valioso en operaciones empresariales. Esta relevancia se debe a su aplicación en análisis de mercado, investigación y recopilación de datos masivos, donde la precisión y la velocidad son críticas.

Elegir el lenguaje de programación adecuado

Seleccionar el lenguaje correcto es el primer paso crítico en la creación de scripts para web scraping, ya que cada uno ofrece características específicas que se adaptan a diferentes necesidades. Por ejemplo, Python destaca por su simplicidad y bibliotecas como BeautifulSoup y Requests, que facilitan la extracción de contenido HTML. Un consejo práctico es evaluar el tamaño del proyecto: para tareas simples, Python es ideal debido a su curva de aprendizaje suave, mientras que para aplicaciones más complejas, JavaScript con Node.js permite scraping dinámico en sitios con JavaScript, como redes sociales. En experiencias reales, muchos profesionales optan por Python por su extenso ecosistema, lo que acelera el desarrollo y minimiza la depuración.

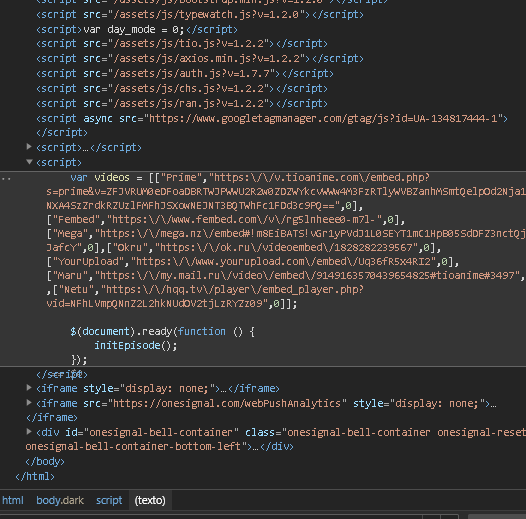

Herramientas esenciales para el scraping

Las herramientas adecuadas potencian la eficiencia de los scripts al proporcionar funcionalidades para navegar, parsear y almacenar datos extraídos. Por instancia, herramientas como Selenium simulan interacciones humanas en páginas web dinámicas, lo cual es útil para sitios que cargan contenido vía AJAX. Un ejemplo práctico es utilizar Selenium en combinación con Python para extraer datos de un e-commerce que actualiza precios en tiempo real; aquí, el script puede automatizar el login y la navegación. Como consejo útil, siempre integra herramientas de depuración como browser inspectors para verificar el XPath o CSS selectors, asegurando que el script sea robusto y evite fallos comunes, basados en lecciones aprendidas en proyectos de automatización empresarial.

Automatizar correos electrónicos sencillosPasos para desarrollar un script de web scraping

El desarrollo de un script de web scraping implica una secuencia lógica de pasos que garantiza la obtención de datos precisos y la automatización efectiva, lo cual es particularmente relevante en industrias como el marketing digital, donde la información actualizada es un activo competitivo. Esta sección detalla el proceso para que los lectores puedan implementar scripts con confianza y minimizar riesgos.

Identificar y extraer datos de manera estructurada

La identificación de elementos en una página web es esencial para extraer datos de forma estructurada, lo que involucra el uso de selectores precisos para evitar datos irrelevantes. Por ejemplo, en un script Python con BeautifulSoup, se puede usar soup.find_all() para localizar todos los elementos con una clase específica, como títulos de productos en una tienda en línea. Un consejo práctico es comenzar con un análisis manual del HTML usando herramientas como el inspector de Chrome, lo que permite refinar el script para capturar solo la información necesaria, como precios o descripciones. En experiencias reales, he observado que estructurar los datos extraídos en formatos como JSON facilita su posterior análisis, mejorando la utilidad en informes automatizados.

Manejo de errores y excepciones en scripts

El manejo adecuado de errores es crucial para que los scripts de web scraping sean resilientes ante problemas como cambios en la estructura de la página o limitaciones de servidores. Por instancia, implementar try-except blocks en Python permite que el script continúe ejecutándose si un elemento no se encuentra, en lugar de abortar. Un ejemplo práctico es configurar timeouts en Requests para evitar que el script se congele en respuestas lentas de servidores. Como consejo útil, incorpora logs detallados para registrar errores, lo que en proyectos reales ha ayudado a depurar y optimizar scripts, asegurando que la automatización sea confiable y eficiente a largo plazo.

Mejores prácticas y consideraciones éticas

Adoptar mejores prácticas en el web scraping no solo mejora la calidad de los scripts, sino que también aborda aspectos éticos y legales, siendo fundamental para mantener la integridad en entornos profesionales donde el uso indebido podría resultar en sanciones. Esta relevancia radica en el equilibrio entre eficiencia y respeto a las normativas web.

Scripts para pruebas automáticasRespetar protocolos y normativas web

Respetar protocolos como robots.txt es un pilar ético en el desarrollo de scripts, ya que indica qué partes de un sitio pueden ser scrapeadas, evitando problemas legales y promoviendo un uso responsable. Por ejemplo, antes de ejecutar un script, verifica el archivo robots.txt de un dominio y ajusta tu código para excluir secciones prohibidas, como en un script que extrae datos públicos de un portal de noticias. Un consejo práctico es implementar delays entre requests para no sobrecargar los servidores, lo cual, en experiencias reales, ha prevenido bloqueos y fomentado relaciones positivas con los sitios web. Esto asegura que la automatización se realice de manera sostenible y ética.

Optimización y escalabilidad de scripts

Optimizar scripts para escalabilidad permite manejar volúmenes grandes de datos sin comprometer el rendimiento, lo que es clave en automatizaciones a gran escala. Por instancia, utiliza técnicas como la paralelización con bibliotecas como concurrent.futures en Python para procesar múltiples páginas simultáneamente. Un ejemplo práctico es escalar un script inicial para extraer datos de miles de páginas, optimizando el código para reducir el tiempo de ejecución mediante caching de respuestas. Como consejo útil, realiza pruebas de carga para identificar cuellos de botella, lo que en proyectos reales ha mejorado la eficiencia, permitiendo que la automatización se adapte a necesidades crecientes sin necesidad de reescrituras extensas.

En resumen, este artículo ha examinado los fundamentos, los pasos de desarrollo y las mejores prácticas para crear scripts de web scraping, destacando la importancia de elegir herramientas adecuadas, manejar errores y respetar normativas éticas. Al implementar estos conceptos, los profesionales pueden lograr una automatización efectiva que impulse la eficiencia en la recopilación de datos. Como llamado a la acción, evalúa tus necesidades de automatización actuales y desarrolla un script simple hoy mismo para experimentar sus beneficios en un proyecto específico.

Usar cron jobs en automatizaciónSi quieres conocer otros artículos parecidos a Cómo hacer scripts para web scraping puedes visitar la categoría Automatización y scripts.

Entradas Relacionadas